Générateur de vidéos IA avec synchronisation labiale

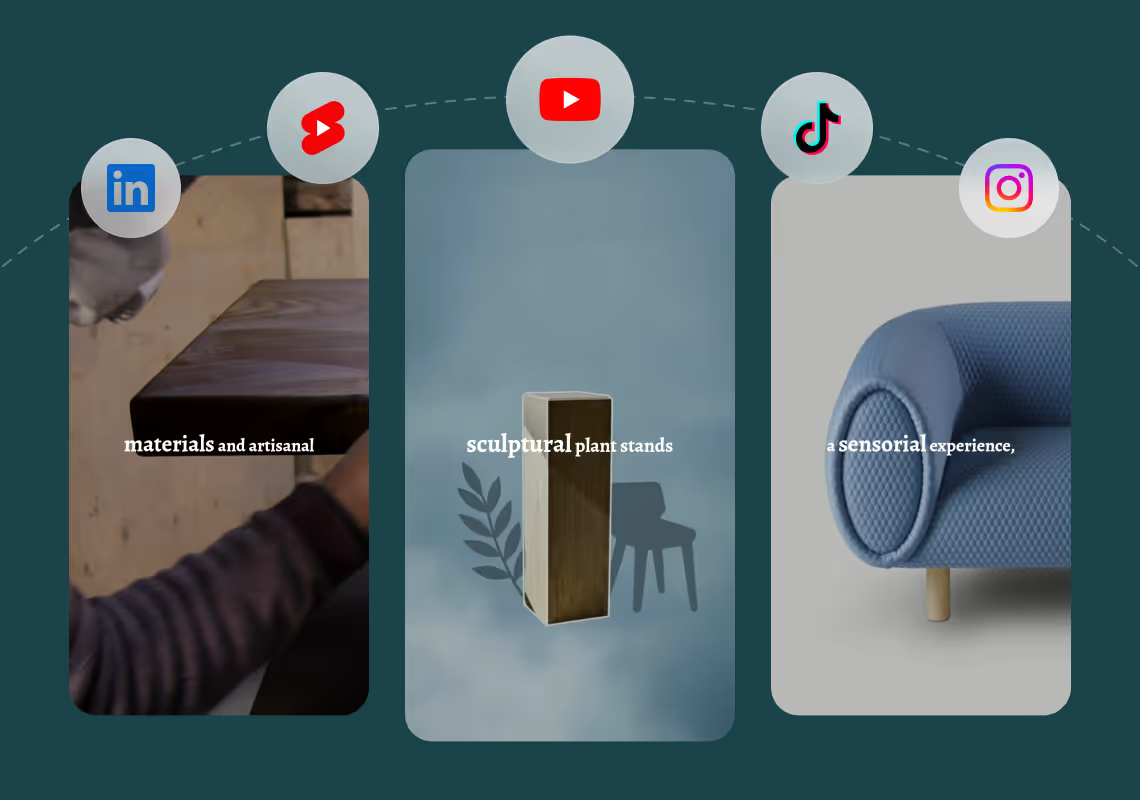

Agent Opus crée des vidéos IA avec synchronisation labiale à partir de n'importe quelle saisie de texte. Décrivez votre message, collez un script ou téléchargez l'URL d'un blog, et obtenez une vidéo de présentateur terminée avec des mouvements de bouche synchronisés, une voix et des animations graphiques. Aucune synchronisation manuelle, aucune timeline de montage, aucun délai de rendu. Votre avatar IA ou voix clonée prononce vos mots avec un alignement labial parfait, prêt à être publié sur TikTok, Instagram Reels, YouTube Shorts ou LinkedIn. Une seule instruction génère une vidéo complète.

Explore what's possible with Agent Opus

Reasons why creators love Agent Opus' Générateur de vidéos IA avec synchronisation labiale

Repurpose Content Instantly

Turn one recording into multiple versions for different platforms, audiences, or campaigns without starting from scratch.

Scale Without Burnout

Create dozens of personalized videos in the time it used to take for one, freeing you to focus on strategy and growth.

Perfect Sync Every Time

Never worry about mismatched audio again—your lips move naturally with every word, accent, and pause.

Scale Content Effortlessly

Create dozens of personalized video variations from one recording, each perfectly lip-synced to different scripts.

Fix Mistakes in Seconds

Update dialogue or correct errors without re-recording footage, saving hours of production time.

Launch-Ready in Minutes

Skip studio costs and lengthy editing sessions while delivering perfectly synced videos that look professionally produced.

How to use Agent Opus’ Générateur de vidéos IA avec synchronisation labiale

1

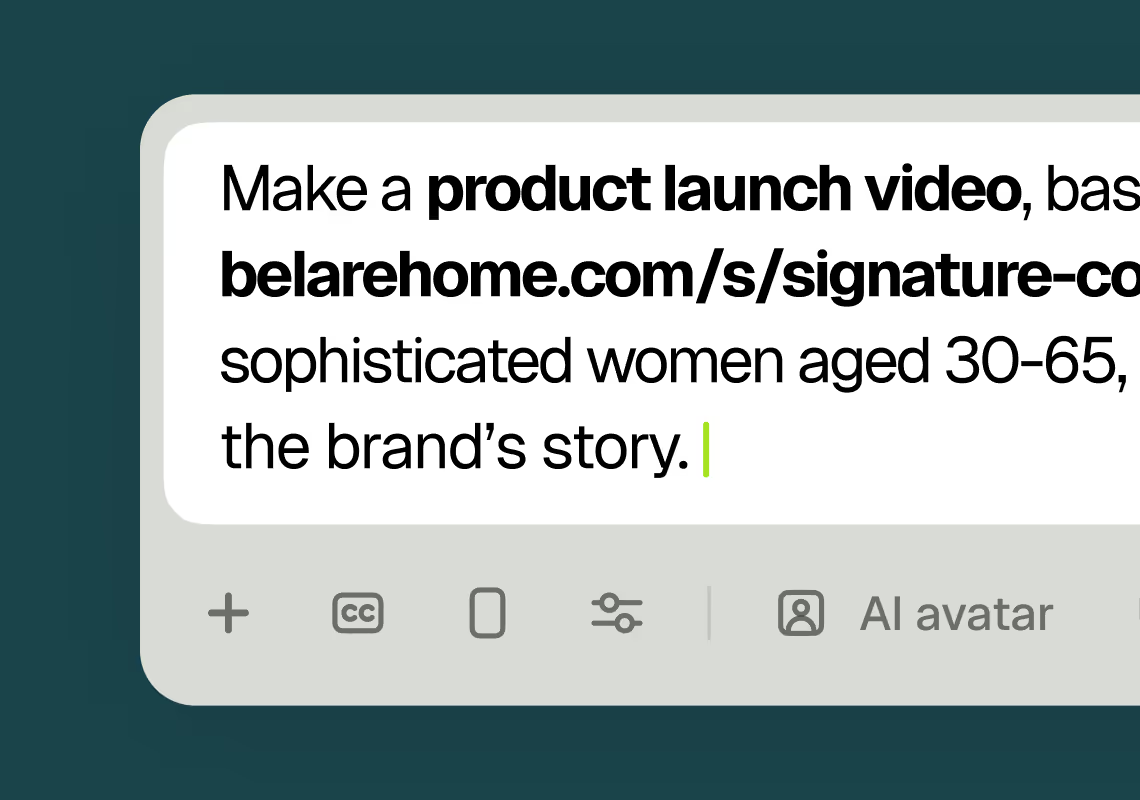

1Describe your video

Paste your promo brief, script, outline, or blog URL into Agent Opus.

2

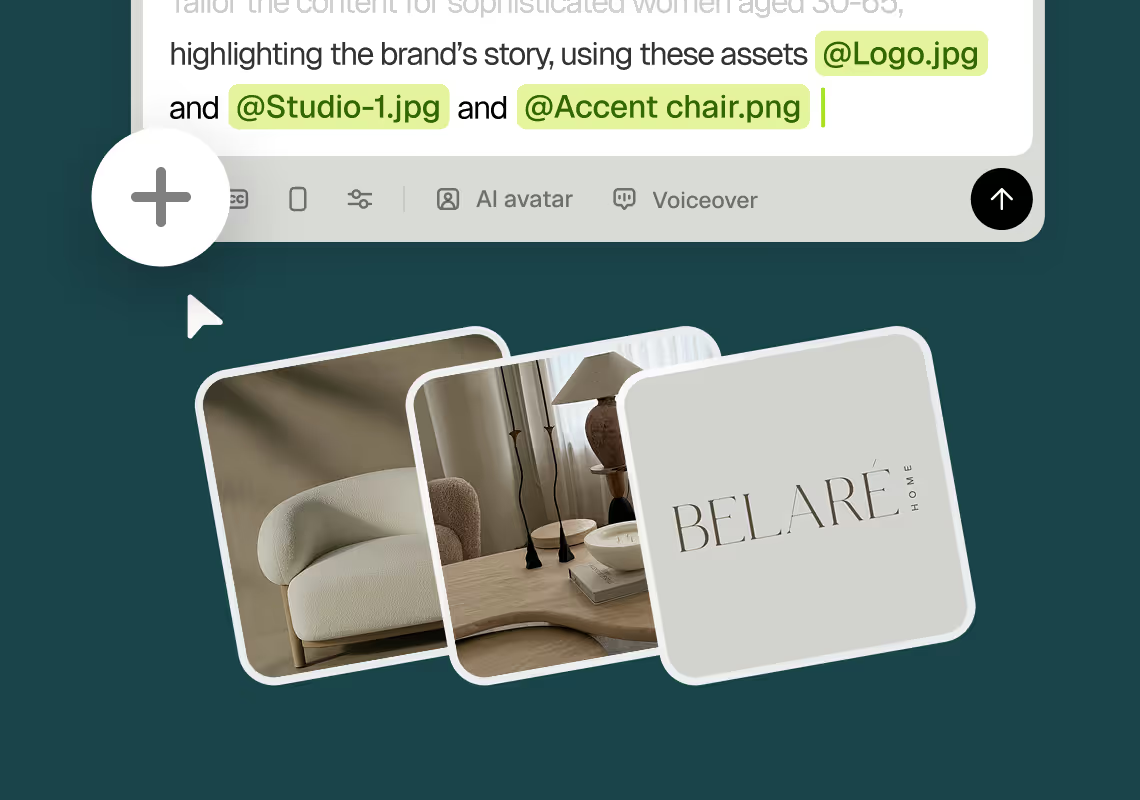

2Add assets and sources

Upload brand assets like logos and product images, or let the AI source stock visuals automatically.

3

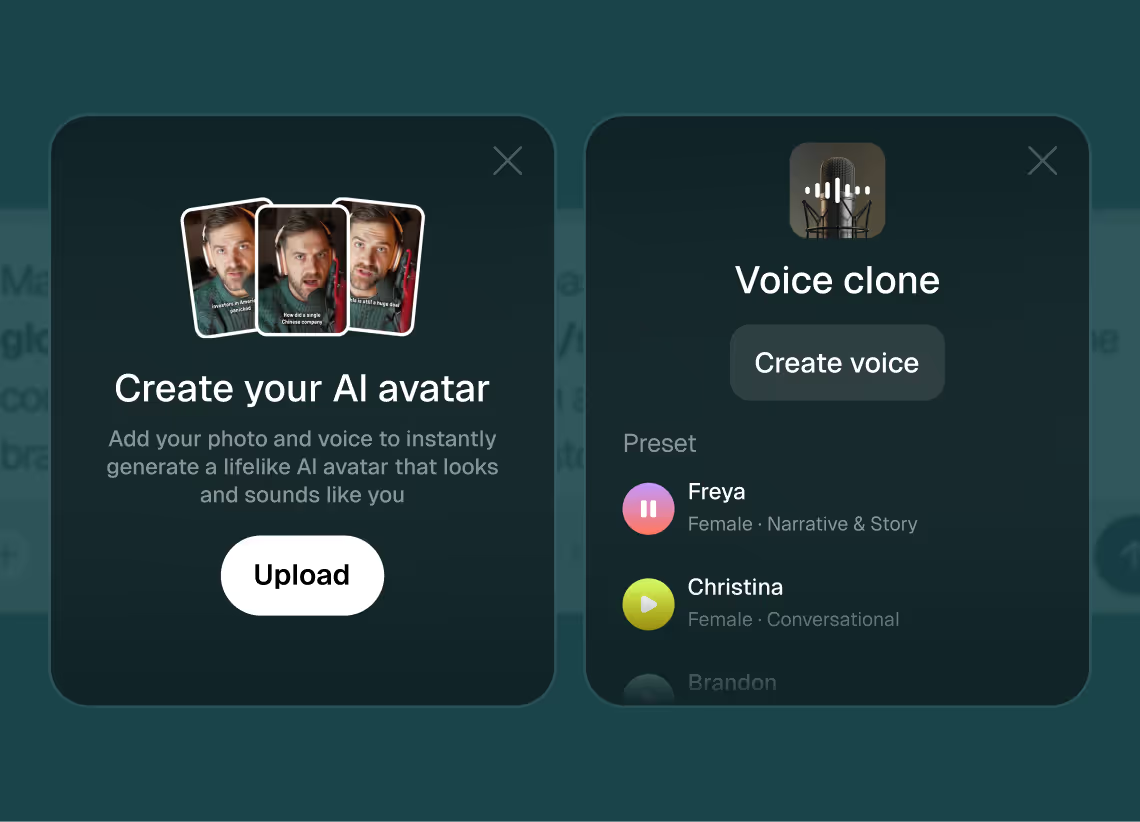

3Choose voice and avatar

Choose voice (clone yours or pick an AI voice) and avatar style (user or AI).

4

4Generate and publish-ready

Click generate and download your finished promo video in seconds, ready to publish across all platforms.

8 powerful features of Agent Opus' Générateur de vidéos IA avec synchronisation labiale

Custom Voice Integration

Upload your own audio and watch AI avatars lip sync perfectly to your narration.

Multi-Language Sync

Create lip-synced videos in dozens of languages with accurate phoneme matching.

Realistic Lip Sync

Generate videos where avatar mouths move naturally in sync with your audio script.

Brand-Consistent Avatars

Choose or customize avatars that lip sync on-brand messaging across all your videos.

Testimonials

Awesome output, Most of my students and followers could not catch that it was using Agent Opus. Thank you Opus.

Wealth with Gaurav

This looks like a game-changer for us. We're building narrative-driven, visually layered content — and the ability to maintain character and motion consistency across episodes would be huge. If Agent Opus can sync branded motion graphics, tone, and avatar style seamlessly, it could easily become part of our production stack for short-form explainers and long-form investigative visuals.

srtaduck

I reviewed version a and I was very impressed with this version, it did very well in almost all aspects that users need, you would only have to make very small changes and maybe replace one of 2 of the pictures, but even saying that it could be used as is and still receive decent views or even chances at going viral depending on the story or the content the user chooses.

Jeremy

all in all LOVE THIS agent. I'm curious to see how I can push it (within reason) Just need to learn to get the consistency right with my prompts

Rebecca

Frequently Asked Questions

Comment la vidéo IA avec synchronisation labiale gère-t-elle différents styles de voix et accents ?

Agent Opus analyse la structure phonétique de votre audio quel que soit l'accent, la vitesse d'élocution ou le ton vocal. Lorsque vous clonez votre voix ou sélectionnez une voix IA, le système associe chaque phonème (la plus petite unité de son de parole) à une forme de bouche correspondante, ou visème. Cette correspondance phonème-visème fonctionne dans toutes les langues et tous les accents car elle opère au niveau du son, pas au niveau du mot. Si vous parlez avec un accent régional, l'IA détecte les sons réels que vous produisez et synchronise la bouche de l'avatar pour correspondre à ces prononciations exactes. Pour les locuteurs rapides, le système ajuste le timing de chaque forme de bouche pour suivre le rythme des syllabes rapides. Pour une élocution lente et délibérée, il prolonge la durée de chaque visème afin que les lèvres ne semblent jamais en retard ou en avance sur l'audio. Le résultat est une synchronisation labiale naturelle qui respecte vos caractéristiques vocales uniques. Vous pouvez tester cela en générant des vidéos avec différents clones de voix ou voix IA et en comparant les mouvements de bouche. Chacun se synchronisera avec précision car l'analyse phonétique sous-jacente s'adapte à l'entrée audio, et non à un modèle générique.

Quelles sont les meilleures pratiques pour rédiger des scripts qui produisent la vidéo IA avec synchronisation labiale la plus naturelle ?

Une synchronisation labiale naturelle commence par des scripts conversationnels qui correspondent à la façon dont les gens parlent réellement. Évitez les phrases longues et complexes avec plusieurs propositions, car elles obligent l'avatar à maintenir des formes de bouche pendant des périodes prolongées sans pauses naturelles. Privilégiez plutôt des phrases courtes avec une structure sujet-verbe-objet claire. Utilisez des contractions comme "vous êtes" au lieu de formes plus formelles, car les contractions reflètent les modèles de parole réels et produisent des transitions de bouche plus fluides. Incluez des pauses naturelles en ajoutant des virgules ou en séparant les idées en phrases distinctes. Cela donne à l'IA des indices pour fermer brièvement la bouche, imitant la façon dont les humains font une pause pour respirer ou souligner un point. Évitez le jargon technique ou les mots inventés à moins de pouvoir les épeler phonétiquement, car l'IA peut mal prononcer des termes inconnus et créer un mouvement labial désynchronisé. Si votre script inclut des chiffres, écrivez-les en toutes lettres ("vingt-trois" au lieu de "23") afin que le générateur de voix les prononce correctement et que la synchronisation labiale suive. Testez votre script en le lisant à voix haute avant de générer la vidéo. S'il semble rigide ou peu naturel lorsque vous le prononcez, l'avatar aura également l'air rigide. Agent Opus fonctionne mieux avec des scripts qui sonnent comme une vraie personne parlant à un ami, et non comme quelqu'un lisant un prompteur.

La vidéo IA avec synchronisation labiale peut-elle maintenir une image de marque cohérente sur plusieurs vidéos avec différents scripts ?

Oui, Agent Opus vous permet de télécharger des éléments de marque tels que des logos, des images de produits et des palettes de couleurs qui persistent dans tous vos projets de vidéos IA avec synchronisation labiale. Lorsque vous générez une nouvelle vidéo, le système puise dans votre bibliothèque d'éléments pour encadrer l'avatar avec des éléments visuels cohérents. Par exemple, vous pouvez définir un bandeau inférieur par défaut avec votre logo et votre slogan qui apparaît dans chaque vidéo, ou définir un modèle d'arrière-plan qui utilise les couleurs de votre marque et des photos de produits. L'avatar lui-même peut également être cohérent. Si vous téléchargez une photo de vous-même ou d'un membre de l'équipe, Agent Opus génère une version numérique de ce visage et l'utilise pour chaque vidéo que vous créez. Associez cela à une voix clonée, et chaque vidéo présente le même intervenant avec la même identité visuelle et vocale. Cette cohérence est importante pour construire la reconnaissance du public. Les spectateurs voient le même visage et entendent la même voix dans votre contenu TikTok, LinkedIn et YouTube, renforçant votre marque même lorsque le script change. Vous pouvez également créer plusieurs paires avatar-voix pour différents types de contenu. Par exemple, utilisez un avatar pour les démonstrations de produits et un autre pour les témoignages de clients, chacun avec sa propre voix clonée et son modèle d'arrière-plan. Agent Opus enregistre ces configurations afin que vous puissiez basculer entre elles sans avoir à retélécharger des éléments ou ajuster les paramètres.

Quelles sont les limitations ou cas particuliers de la génération de vidéos IA avec synchronisation labiale ?

La vidéo IA avec synchronisation labiale fonctionne mieux avec un discours clair et conversationnel dans des langues largement parlées. Les cas particuliers incluent des scripts avec un bruit de fond important dans le clone vocal, des effets vocaux extrêmes comme chuchoter ou crier, ou des langues avec des ensembles de phonèmes peu représentés dans les données d'entraînement. Si vous clonez votre voix à partir d'un enregistrement avec de la musique ou du son ambiant, l'IA peut avoir du mal à isoler les phonèmes de la parole, conduisant à une synchronisation labiale moins précise. Pour éviter cela, enregistrez votre clone vocal dans un environnement calme avec un microphone décent. Les styles vocaux extrêmes défient également le système. Chuchoter réduit l'énergie acoustique de certains phonèmes, rendant plus difficile pour l'IA de détecter les transitions de forme de bouche. Crier ou chanter introduit des variations de hauteur qui peuvent perturber la correspondance phonème-visème. Pour de meilleurs résultats, utilisez une voix naturelle à volume modéré. Un autre cas particulier est l'alternance rapide entre langues au sein d'un même script. Si votre script alterne entre le français et l'anglais au milieu d'une phrase, l'IA peut ne pas effectuer de transitions fluides des formes de bouche car chaque langue a des règles phonétiques différentes. Restez sur une langue par vidéo, ou séparez le contenu multilingue en clips distincts. Enfin, les scripts très longs (plus de 10 minutes de parole) peuvent produire des vidéos où l'expression de l'avatar devient statique au fil du temps. Agent Opus génère des micro-expressions et des mouvements de tête pour garder l'avatar vivant, mais les monologues prolongés peuvent sembler moins dynamiques que les vidéos plus courtes et percutantes. Divisez le contenu long en plusieurs vidéos pour maintenir l'intérêt visuel et donner à l'IA plus d'opportunités de varier la performance de l'avatar.