KI-Talking-Avatar-Videogenerator

Verwandeln Sie jeden Text in wenigen Minuten in ein ausgefeiltes KI-Talking-Avatar-Video. Agent Opus generiert vollständige Videos mit KI-Avataren, individuellen Voiceovers und dynamischen Motion Graphics aus einem einfachen Prompt, Skript oder Blog-URL. Keine Timeline, keine Bearbeitung, keine Designkenntnisse. Beschreiben Sie einfach, was Sie benötigen, und erhalten Sie ein veröffentlichungsfertiges Video mit einem professionellen Talking-Avatar, der erklärt, verkauft oder lehrt. Perfekt für Produktdemos, Erklärvideos, Social-Media-Inhalte und Schulungsmaterialien. Beginnen Sie noch heute mit der Erstellung professioneller KI-Talking-Avatar-Videos.

Explore what's possible with Agent Opus

Reasons why creators love Agent Opus' KI-Talking-Avatar-Videogenerator

On-Brand in Every Frame

Keep your visual identity consistent across every talking avatar video, no matter who's on your team.

Reach Global Audiences Effortlessly

Deliver your message in multiple languages with natural-sounding talking avatars that connect across borders.

How to use Agent Opus’ KI-Talking-Avatar-Videogenerator

1

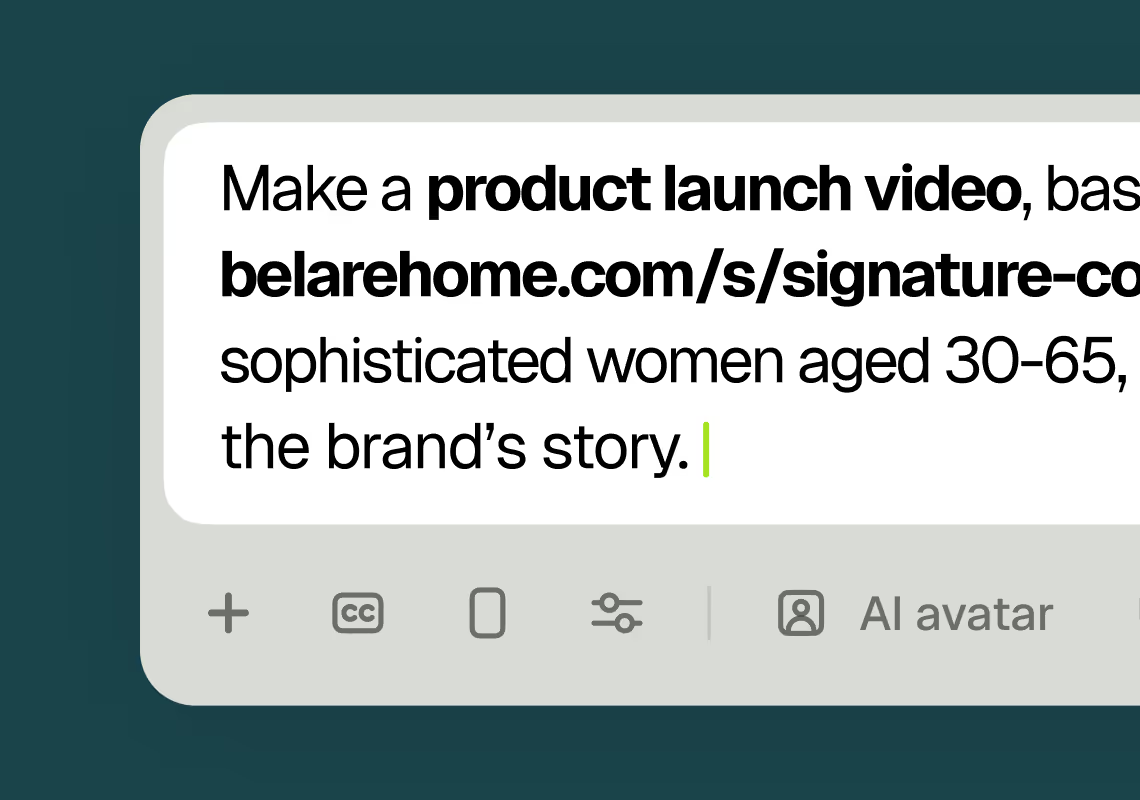

1Describe your video

Paste your promo brief, script, outline, or blog URL into Agent Opus.

2

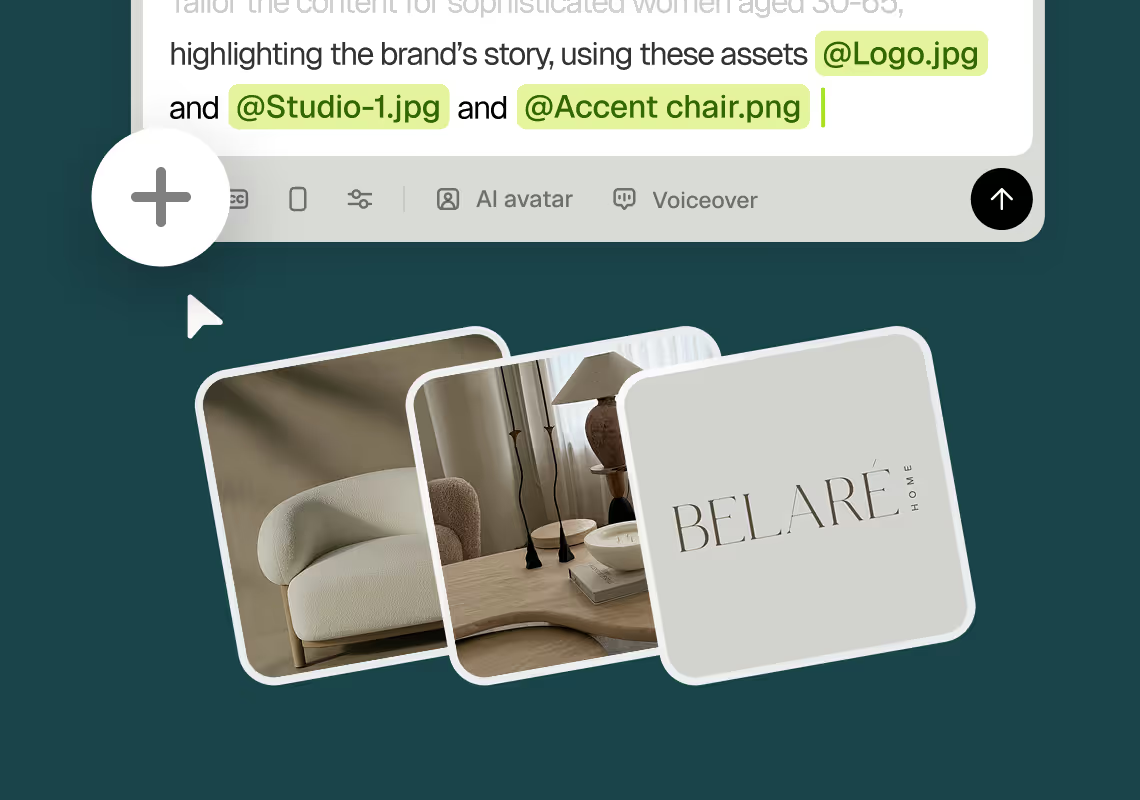

2Add assets and sources

Upload brand assets like logos and product images, or let the AI source stock visuals automatically.

3

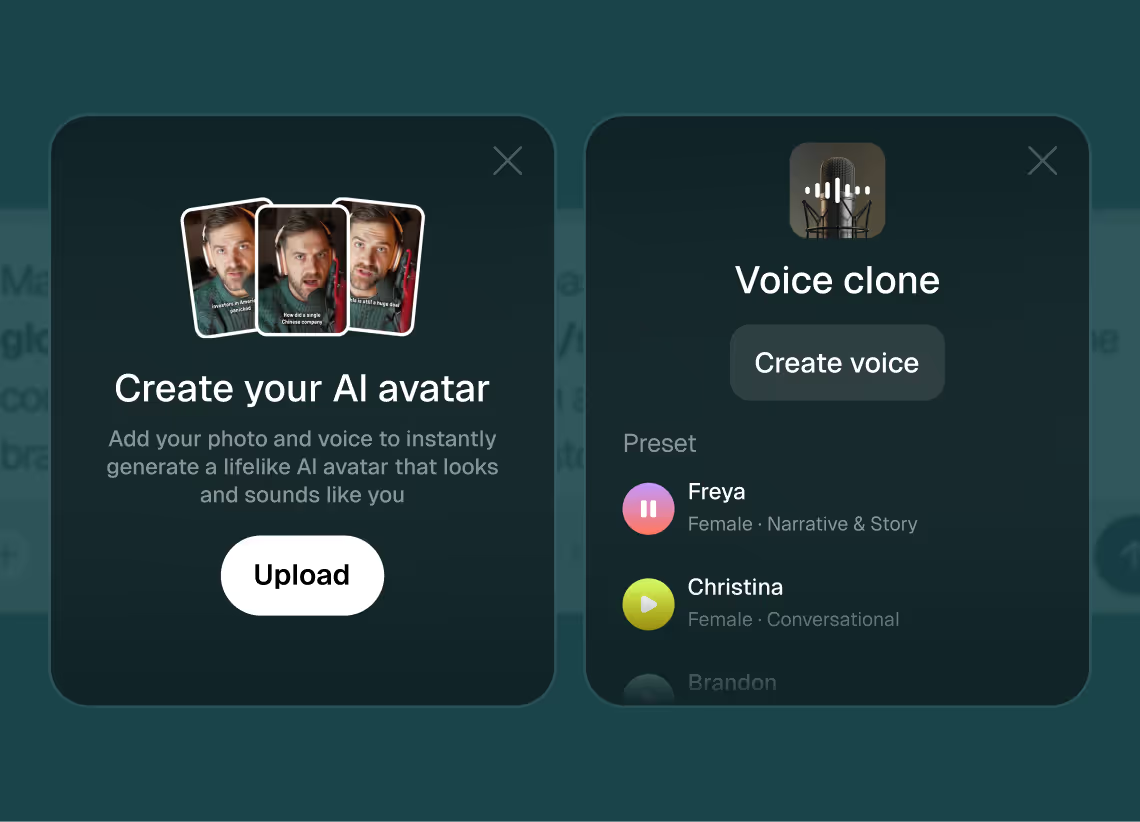

3Choose voice and avatar

Choose voice (clone yours or pick an AI voice) and avatar style (user or AI).

4

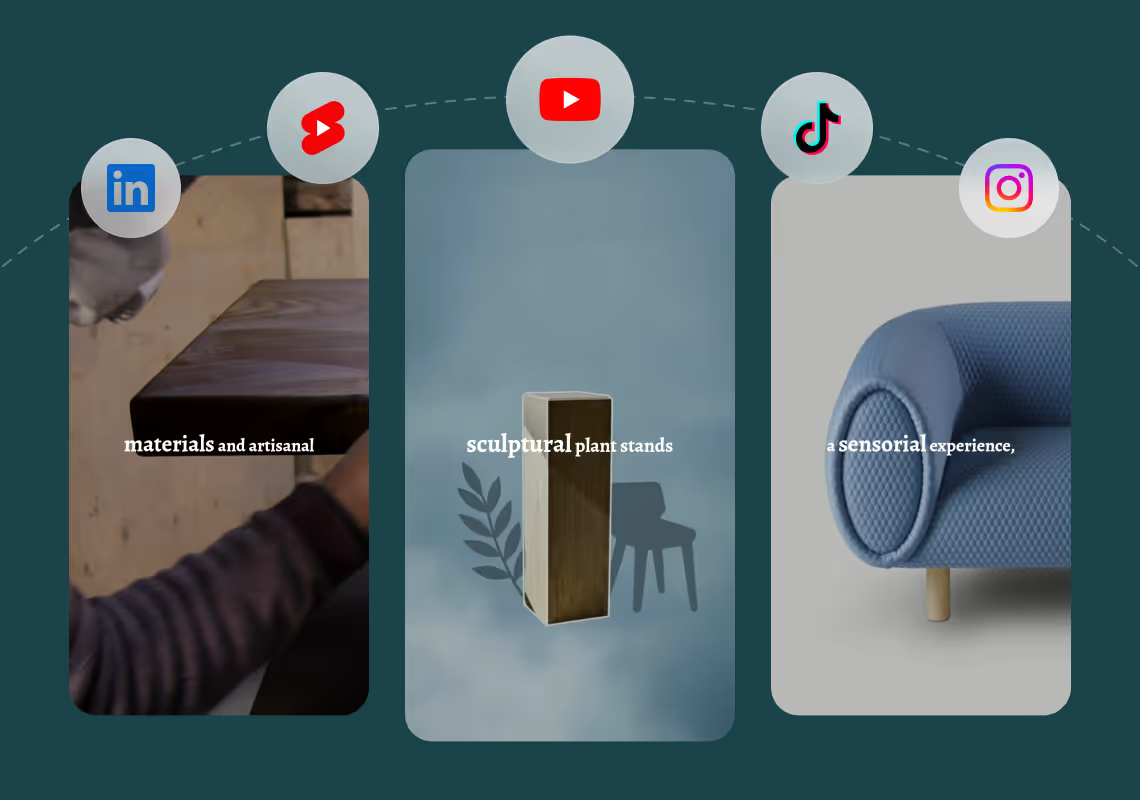

4Generate and publish-ready

Click generate and download your finished promo video in seconds, ready to publish across all platforms.

8 powerful features of Agent Opus' KI-Talking-Avatar-Videogenerator

Realistic Lip Sync

AI matches mouth movements perfectly to your script for natural, believable avatar speech.

Emotion Control

Adjust avatar tone and facial expressions to match your message's mood and intent.

Voice Selection

Pair your avatar with AI voices that match gender, age, and accent for authentic delivery.

Script to Avatar Video

Paste your script and watch AI transform it into a polished avatar presentation instantly.

Testimonials

Awesome output, Most of my students and followers could not catch that it was using Agent Opus. Thank you Opus.

Wealth with Gaurav

This looks like a game-changer for us. We're building narrative-driven, visually layered content — and the ability to maintain character and motion consistency across episodes would be huge. If Agent Opus can sync branded motion graphics, tone, and avatar style seamlessly, it could easily become part of our production stack for short-form explainers and long-form investigative visuals.

srtaduck

I reviewed version a and I was very impressed with this version, it did very well in almost all aspects that users need, you would only have to make very small changes and maybe replace one of 2 of the pictures, but even saying that it could be used as is and still receive decent views or even chances at going viral depending on the story or the content the user chooses.

Jeremy

all in all LOVE THIS agent. I'm curious to see how I can push it (within reason) Just need to learn to get the consistency right with my prompts

Rebecca

Frequently Asked Questions

Wie funktioniert die KI-Talking-Avatar-Videogenerierung mit verschiedenen Eingabetypen?

Agent Opus akzeptiert vier Eingabetypen für die Erstellung von KI-Talking-Avatar-Videos, die jeweils für unterschiedliche Workflows optimiert sind. Erstens können Sie einen einfachen Prompt schreiben, der beschreibt, was der Avatar sagen und zeigen soll. Zum Beispiel: „Erstelle eine 60-sekündige Produktdemo, in der ein KI-Avatar die Funktionen unserer neuen Planungs-App erklärt.

Was sind Best Practices für Prompts beim Erstellen von KI-Talking-Avatar-Videos?

Effektive Prompts für die KI-Talking-Avatar-Videogenerierung balancieren Spezifität mit kreativer Flexibilität. Beginnen Sie damit, Ihr Kernziel in einem klaren Satz zu definieren. Anstatt „mache ein Video über Marketing

Können KI-Talking-Avatar-Videos konsistentes Branding über mehrere Videos hinweg aufrechterhalten?

Ja, Agent Opus ist speziell für Markenkonsistenz über KI-Talking-Avatar-Videobibliotheken hinweg entwickelt. Das System ermöglicht es Ihnen, Markenparameter einmal festzulegen und sie dann automatisch auf jedes von Ihnen generierte Video anzuwenden. Beginnen Sie mit dem Hochladen Ihrer wichtigsten Marken-Assets: Logo-Dateien, Produktbilder, Markenfarbcodes und alle benutzerdefinierten Grafiken, die Sie regelmäßig verwenden. Diese werden Teil Ihrer Asset-Bibliothek, auf die Agent Opus während der Generierung verweist. Für Avatar-Konsistenz können Sie einen bestimmten KI-Avatar als Ihren Markenrepräsentanten auswählen und ihn für alle Videos festlegen. Egal, ob Sie Produktdemos, Tutorials oder Social-Media-Inhalte erstellen, derselbe Avatar erscheint und baut Wiedererkennung und Vertrauen bei Ihrem Publikum auf. Stimmkonsistenz funktioniert genauso. Klonen Sie Ihre Stimme einmal, und jedes KI-Talking-Avatar-Video verwendet genau dieses Stimmprofil. Dies ist entscheidend für persönliche Marken, bei denen Authentizität wichtig ist. Alternativ wählen Sie eine bestimmte KI-Stimme aus und speichern Sie sie als Ihre Markenstimme. Das System merkt sich Tonhöhe, Tempo und tonale Charakteristika und stellt sicher, dass jedes Video so klingt, als käme es aus derselben Quelle. Visuelle Stilkonsistenz erstreckt sich auf Motion Graphics und Szenenzusammensetzung. Agent Opus lernt Ihre Präferenzen im Laufe der Zeit. Wenn Sie konsequent bestimmte Übergangsstile, Farbüberlagerungen oder Textanimationsmuster verwenden, integriert die KI diese automatisch in zukünftige Videos. Sie erstellen Ihren Stil nicht manuell für jedes Projekt neu. Für Multi-Video-Kampagnen können Sie Vorlagen basierend auf erfolgreichen Videos erstellen. Wenn Sie ein KI-Talking-Avatar-Video generieren, das gut funktioniert, speichern Sie seine strukturellen Elemente als Vorlage. Zukünftige Videos können dasselbe Tempo, dieselbe Szenenstruktur und denselben visuellen Rhythmus übernehmen, während sie Inhalte an neue Themen anpassen. Dies ist besonders wertvoll für Serieninhalte, bei denen Formatkonsistenz die Zuschauer bei der Stange hält. Die Integration von Marken-Assets erfolgt automatisch während der Generierung. Wenn Agent Opus Bilder bezieht oder Motion Graphics erstellt, priorisiert es Ihre hochgeladenen Assets gegenüber generischem Stock-Material. Ihre Produktaufnahmen erscheinen in relevanten Szenen, Ihr Logo behält eine konsistente Platzierung bei, und Ihre Markenfarben dominieren die visuelle Palette. Für Teams, die mehrere Marken oder Kunden verwalten, können Sie separate Markenprofile innerhalb von Agent Opus erstellen. Wechseln Sie zwischen Profilen, um KI-Talking-Avatar-Videos mit völlig unterschiedlichen visuellen Identitäten, Stimmen und Asset-Bibliotheken zu generieren. Dies verhindert Kreuzkontamination und stellt sicher, dass jede Marke ihre einzigartige Präsenz beibehält. Der entscheidende Vorteil ist Skalierbarkeit. Sobald Ihre Markenparameter festgelegt sind, können Sie Dutzende von KI-Talking-Avatar-Videos ohne manuelle Qualitätskontrolle generieren. Jedes Video hält sich automatisch an Ihre Richtlinien, vom Avatar-Erscheinungsbild über die Farbkorrektur bis hin zu den Stimmcharakteristika.

Was sind die Einschränkungen oder Grenzfälle der KI-Talking-Avatar-Videogenerierung?

Das Verständnis der Grenzen der KI-Talking-Avatar-Videogenerierung hilft Ihnen, realistische Erwartungen zu setzen und entsprechend zu planen. Erstens kann hochspezialisierter oder technischer Jargon zusätzlichen Kontext in Ihren Prompts erfordern. Wenn Sie Videos über Nischenbranchen mit ungewöhnlicher Terminologie erstellen, geben Sie Definitionen oder Beispiele an, damit Agent Opus Konzepte visuell genau darstellen kann. Die KI ist auf breites Wissen trainiert, benötigt aber möglicherweise Anleitung für extrem spezialisierte Inhalte. Zweitens hat die Integration von Echtzeit- oder Live-Action-Material Einschränkungen. Agent Opus zeichnet sich durch die Generierung vollständiger Videos aus Text aus, aber wenn Sie bestimmte Live-Action-Clips integrieren müssen, die Sie bereits gefilmt haben, müssen Sie diese als hochgeladene Assets bereitstellen. Das System kann sie in das generierte Video integrieren, erstellt aber kein Live-Action-Material von Grund auf. Drittens erfordern extreme Videolängen strategische Planung. Während Agent Opus Videos von 15 Sekunden bis zu mehreren Minuten effektiv handhabt, können sehr lange Inhalte wie 20-minütige Webinare besser als mehrere kürzere Segmente angegangen werden. Die KI optimiert Tempo und Engagement für typische Social-Media- und Marketing-Videolängen. Viertens hat hochspezifische Avatar-Anpassung praktische Grenzen. Sie können aus einer Reihe von KI-Avataren wählen und sogar benutzerdefinierte Avatare verwenden, die Sie bereitstellen, aber die Anforderung hyperspezifischer physischer Merkmale wie „Avatar mit genau drei Sommersprossen auf der linken Wange